È stato un errore umano o dell’AI a uccidere le bambine della scuola di Minab?

Partecipanti al funerale dei bambini uccisi durante lo sciopero. Fotografia Anadolu Getty Images

Mille decisioni all’ora

Sono le 10.45 del mattino del 28 febbraio 2026 quando i missili colpiscono la scuola elementare femminile Shajareh Tayyebeh di Minab, città nel sud del paese vicino allo Stretto di Hormuz. Insegnanti e bambine tra i sette e i dodici anni sono già in classe. Un primo missile distrugge parte dell’edificio. Il preside sposta i sopravvissuti nella sala di preghiera e chiama i genitori. Un secondo missile colpisce quella zona, uccidendo chi si era messo in salvo, i soccorritori e le famiglie accorse. Il bilancio finale supera le 150 vittime, in grande maggioranza bambine, insegnanti e genitori.

Né gli Stati Uniti né Israele ne hanno pubblicamente assunto la responsabilità. Secondo Reuters, gli investigatori militari statunitensi ritengono che le prove indichino la responsabilità americana. Il Pentagono ha aperto un’indagine. La portavoce della Casa Bianca Karoline Leavitt, alla domanda diretta, ha risposto: “Non che ne siamo a conoscenza.”

Mourners dig graves on Tuesday for those killed in a February 28 strike on the Shajare Tayyiba elementary school in Minab, Iran. Iranian Press Center - AFP Getty Images

Maven, Claude e l’Operazione Epic Fury

Negli stessi minuti in cui Minab veniva colpita, il Maven Smart System di Palantir stava elaborando immagini satellitari, filmati di droni, comunicazioni intercettate e oltre 150 altre fonti di dati per produrre migliaia di opzioni di attacco in tempo reale.

Integrato con il modello linguistico Claude di Anthropic, Maven è il cuore dell’infrastruttura con cui gli Stati Uniti hanno condotto l’Operazione Epic Fury: oltre mille obiettivi colpiti nelle prime ventiquattro ore.

Maven nasce nel 2017 con l’obiettivo di costruire un sistema unificato di comando e controllo che integrasse i flussi di intelligence di tutte le forze armate.

La “latenza della kill chain” (il tempo tra l’identificazione di un obiettivo e l’ordine di fuoco) è scesa da finestre di 72 ore a poche ore.

Il Washington Post ha scritto che il sistema trasforma “settimane di pianificazione bellica in operazioni in tempo reale.”

La partnership tra Palantir e Anthropic risale a novembre 2025, quando le due società hanno unito le forze per trasformare Claude in un motore di ragionamento per il supporto decisionale militare. Il risultato ha elevato Palantir da contractor di nicchia a protagonista della modernizzazione delle forze armate americane.

Il Pentagono ha rifiutato di rispondere alla domanda diretta se sia stato Maven a selezionare la scuola di Minab come obiettivo.

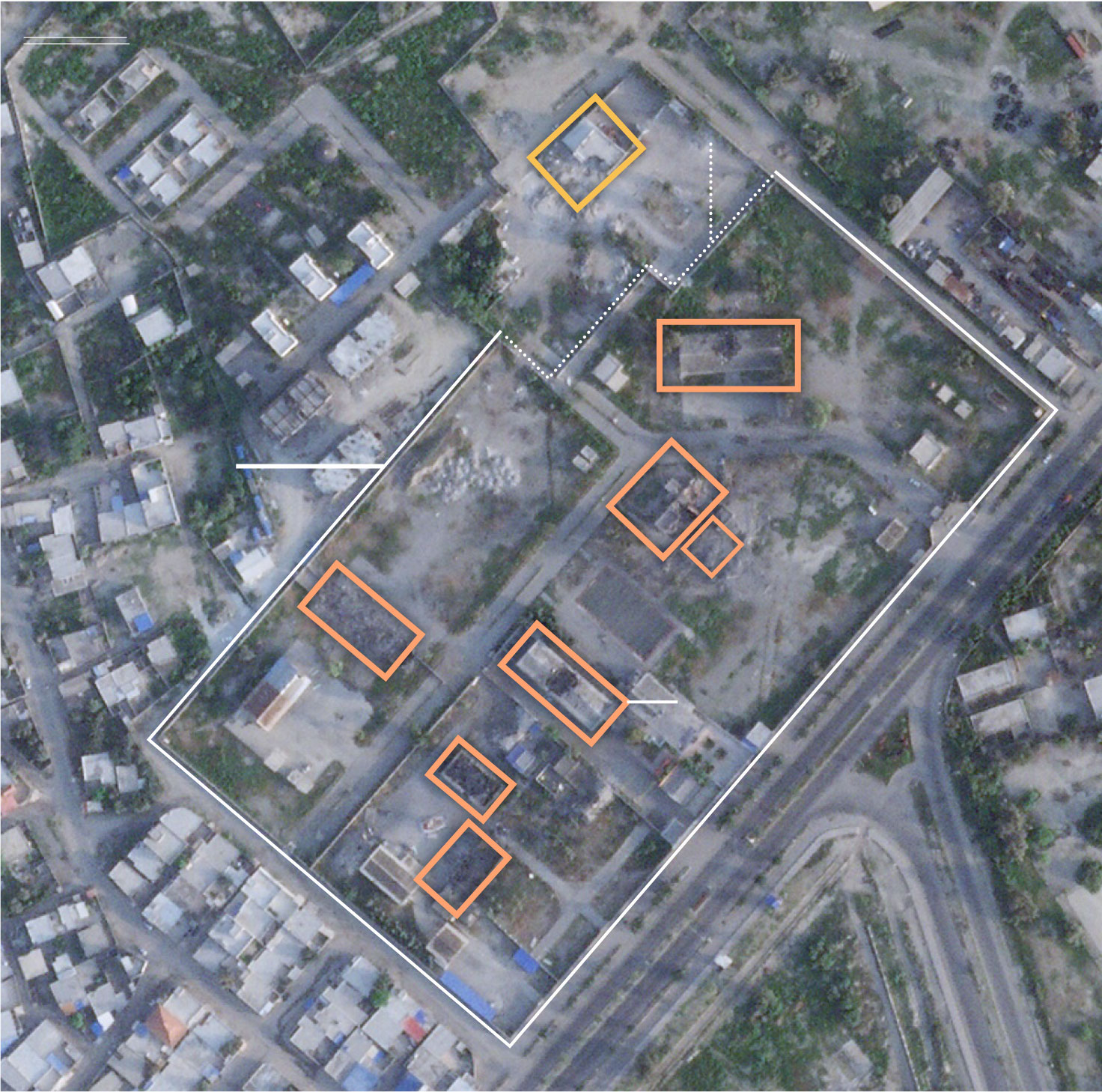

Sources - Planet Labs PBC, CNN analysis. Graphic - Thomas Bordeaux and Rosa de Acosta, CNN

Come essere umano non aggiungevo nessun valore reale

Quello che le immagini satellitari mostrano con chiarezza è un problema di dati, non di algoritmi. La scuola Shajareh Tayyebeh si trova adiacente a una sede del Corpo delle Guardie della Rivoluzione Islamica (IRGC). Tra il 2013 e il 2016 era stata però separata fisicamente dalla base militare da un muro. Una clinica nelle vicinanze era stata ulteriormente isolata tra il 2022 e il 2024. Le mappe di targeting del Pentagono sembrano non essere mai state aggiornate.

Il professor Jeffrey Lewis del Middlebury College, specializzato in analisi di immagini satellitari, ha spiegato che con migliaia di obiettivi distribuiti su tutto il territorio iraniano, è plausibile che alcune schede-obiettivo non fossero aggiornate. Nathan Ruser dell’Australian Strategic Policy Institute ha osservato che l’errore è “chiaramente imputabile all’errore umano, non solo all’intelligenza artificiale”, aggiungendo però che questo non giustifica in alcun modo un attacco che ha ucciso decine di bambine. La ricostruzione di CNN basata su immagini satellitari e perizia sulle munizioni conferma che la scuola era stata separata dalla base già dal 2016.

La distinzione tra errore umano ed errore AI è però, in questo contesto, di fatto accademica.

Quando un sistema è progettato per produrre mille decisioni all’ora, strutturalmente non consente la verifica che avrebbe potuto evitare questo errore: confrontare ogni obiettivo con immagini satellitari aggiornate, controllare che le mappe riflettano la realtà sul terreno, verificare la presenza di strutture civili nelle immediate vicinanze.

Un processo più lento, con queste verifiche obbligatorie, avrebbe avuto una ragionevole possibilità di rilevare che la scuola non faceva più parte del complesso militare da almeno dieci anni.

Non è la prima volta: Lavender a Gaza

Nel 2024 un’inchiesta di +972 Magazine ha rivelato che l’esercito israeliano aveva usato un sistema chiamato Lavender per profilare oltre 37.000 obiettivi a Gaza. Secondo sei ufficiali dell’intelligence israeliana, le decisioni del sistema venivano trattate “come se fossero decisioni umane.” Un operativo ha dichiarato: “Investivo venti secondi per ogni obiettivo e ne facevo decine ogni giorno. Come essere umano non aggiungevo nessun valore reale, ero solo un timbro di approvazione.”

In entrambi i casi, Lavender a Gaza, Maven in Iran, la supervisione umana viene ridotta a una funzione formale, svuotata della sostanza che la rende significativa.

Pete Hegseth, Segretario della difesa degli Stati Uniti

“No stupid rules of engagement”

Il Segretario alla Difesa Pete Hegseth ha presentato l’Operazione Epic Fury al Pentagono il 2 marzo 2026 con queste parole:

“No stupid rules of engagement, no nation building quagmire, no democracy building exercise, no politically correct wars. We fight to win, and we don’t waste time or lives.”

“Niente stupide regole d’ingaggio, niente pantano del nation building, niente esercizi di costruzione della democrazia, niente guerre politicamente corrette.“

Le “stupid rules of engagement” che Hegseth intende eliminare sono le stesse che il diritto internazionale umanitario, firmato dagli Stati Uniti, impone per proteggere i civili.

L’UNESCO ha definito l’attacco alla scuola di Minab “una grave violazione della protezione garantita alle scuole dal diritto internazionale umanitario.”

L’Alto Commissario ONU per i diritti umani Volker Türk ha sollevato domande esplicite sulla proporzionalità dell’operazione e sull’aggiornamento delle precauzioni adottate.

Supervisione umana e stupide regole

Cosa succede quando si costruisce una macchina da guerra in cui la velocità è un valore, la supervisione umana è ridotta a una formalità e le “regole stupide” sono quelle che impongono di fermarsi a verificare se l’edificio che stai per colpire ospita delle bambine?

La risposta non è nei codici etici delle aziende AI, né nelle dichiarazioni del Pentagono. È nelle immagini satellitari di Minab che mostrano le file ordinate di oltre cento tombe, scavate tre giorni dopo l’attacco.

Fonti: Reuters · Bloomberg · Washington Post · CNN · +972 Magazine · PBS NewsHour · UN News / UNESCO