Una giornata normale.

AI e sorveglianza di massa.

Sofia, 36 anni. Milano.

Sofia si sente al sicuro. Ogni mattina clicca “Accetta tutto” sui banner dei cookie per inerzia: il tasto per rifiutare è piccolo, grigio e nascosto. Mentre legge le notizie, il suo browser comunica un fingerprint unico: non solo il sistema operativo, ma il livello di carica della batteria e la velocità con cui si scarica. Il sistema registra perfino come l’accelerometro reagisce alle micro-vibrazioni del dispositivo mentre lo tiene in mano. È un identificatore univoco, quasi impossibile da mascherare anche con una VPN.

La sua vita è organizzata su Google Calendar (visite mediche, appuntamenti, impegni) e passa per Gmail. Anche se usa una chat cifrata, i metadati di Messenger e WhatsApp (chi sente, quando e da dove) sono a disposizione delle autorità su richiesta. Nel frattempo, Netflix registra orari, abitudini e scelte di visione: sa se soffre d’insonnia, inferisce stati d’ansia, e dai contenuti che seleziona costruisce un’ipotesi sui suoi orientamenti politici e culturali.

Tutto questo finisce in un report di “affidabilità comportamentale” che un broker vende alla banca quando Sofia chiede un mutuo. Il sistema incrocia le ricerche mediche, gli orari irregolari, le frequentazioni digitali. Il responso è un tasso d’interesse più alto perché il suo “profilo di resilienza” è considerato basso.

Sofia pagherà di più per colpa di un algoritmo che ha interpretato i suoi dati come segnali di instabilità. Non saprà mai perché.

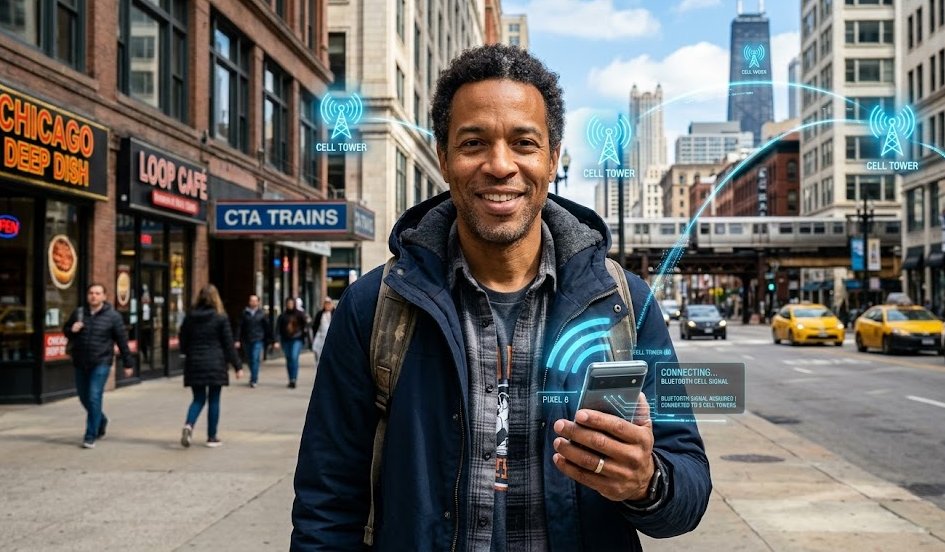

Marcus, 43 anni. Chicago.

Marcus parla con la sua AI e le confessa lo stress per il lavoro, le chiede consigli su come gestire l’ansia, le racconta i suoi dubbi esistenziali. Non sa che quelle conversazioni sono dati processati per estrarre il suo stato emotivo e psicologico. Il sistema analizza le parole, il tono della voce, i pattern temporali e mappa i suoi picchi di stress con precisione crescente.

Quando esce di casa e sale in auto, il sistema di sorveglianza fisica prende il testimone. Lungo i viali di Chicago, le telecamere ambientali montate sui semafori e sulle auto della polizia leggono la sua targa migliaia di volte al giorno. Ogni passaggio è un timestamp: il sistema sa a che ora Marcus è uscito, quale percorso ha fatto e, incrociando i dati, sa quali altre targhe si muovono spesso “in colonna” con la sua. Se l’auto di un attivista politico è parcheggiata regolarmente vicino alla sua, il database crea un legame associativo automatico, anche se i due non si sono mai scambiati un messaggio.

Mentre guida, il suo telefono aggancia le celle dell’operatore telefonico ricostruendo ogni spostamento. Nei centri commerciali e nelle piazze, il Bluetooth intercetta il segnale dello smartphone anche se non è connesso a nulla. Questo permette una mappatura di rete chirurgica: il sistema sa che Marcus incontra regolarmente le stesse venti persone in un seminterrato ogni martedì sera. Le telecamere esterne confermano che le loro auto sono tutte parcheggiate nello stesso raggio di 200 metri.

Anche se nessuno di loro ha mai dichiarato un’affiliazione politica, l’AI li ha già classificati come gruppo organizzato ad alto indice di attivismo.

Marcus non viene arrestato. Semplicemente, il suo nome finisce in una query della polizia predittiva.

Quando l’ufficio delle tasse deve decidere chi sottoporre a un controllo fiscale aggressivo, il sistema sceglie lui.

Non perché abbia sbagliato i conti, ma perché il suo profilo (costruito tra confidenze all’AI, targhe riprese per strada e segnali Bluetooth) lo colloca in una rete sociale considerata “poco collaborativa” con le istituzioni.

Elena, 20 anni. Roma.

Stagista in una grande azienda, lavora con la suite Microsoft 365. L’azienda utilizza: strumenti di analytics, come Viva Insights, che analizzano metadati (numero di email, tempo in riunione, ampiezza della rete interna, tempi di risposta. Non leggono i contenuti, ma misurano i pattern di interazione), e tecniche di Organizational Network Analysis che mappano come circolano relazioni e competenze.

Formalmente è tutto conforme all’art. 4 dello Statuto dei Lavoratori: gli strumenti sono presentati come necessari all’organizzazione del lavoro e al benessere aziendale, e i dipendenti sono informati del trattamento dei dati.

Elena consegna puntuale, ma comunica poco. Scrive meno email della media, interviene raramente nelle chat, partecipa solo alle riunioni necessarie. Nei report HR risulta con bassa centralità relazionale e compare tra i profili a possibile “rischio di turnover”, un indicatore a supporto delle valutazioni manageriali. L’HR verifica poi anche i suoi profili social pubblici.

E a fine stage non viene confermata. Nel verbale si legge: “Limitata integrazione nella rete collaborativa e bassa proattività comunicativa.”

Non c’è un algoritmo che la epura.

È un sistema che la misura non per quello che fa realmente, ma per quanto assomiglia al profilo atteso.

Cosa è cambiato.

Per decenni la re-identificazione, ovvero risalire a una persona specifica partendo da dati apparentemente anonimi, è stato un processo lungo, costoso, che richiedeva tecnici specializzati, accesso a più fonti, settimane di lavoro. E quindi veniva fatto solo quando c’era una ragione precisa: un’indagine, un sospetto, un mandato. La sorveglianza era costosa, quindi selettiva. I dati personali erano frammentati, archiviati in sistemi separati, difficili da incrociare.

Poi abbiamo cominciato a produrre e lasciare traccia di centinaia di segnali al giorno: posizione, acquisti, ricerche, relazioni, stati emotivi inferiti.

Questi dati vengono ceduti attraverso termini di servizio che nessuno legge, venduti da chi li raccoglie a broker di primo livello, rivenduti ad aggregatori di secondo livello che costruiscono profili con fino a 10.000 attributi per persona. Società come Acxiom, LexisNexis, Experian hanno profili su miliardi di individui.

I dati sono “pubblici” nel senso che sono stati ceduti volontariamente a soggetti privati: e questo basta a farli uscire dalla protezione costituzionale.

Infine è arrivata l’AI: l’aggregazione e la re-identificazione sono diventate automatiche, istantanee e applicabili su scala di massa.

Un sistema di AI non costruisce il profilo di una persona specifica su richiesta: costruisce il profilo di tutti, e poi risponde a interrogazioni.

“Dammi tutti i residenti di Milano che hanno frequentato una moschea negli ultimi tre mesi.”

“Dammi tutti i candidati a un concorso pubblico con un profilo di attivismo politico superiore a una certa soglia.”

L’interrogazione richiede secondi e nessun mandato, perché i dati sono già stati acquistati da soggetti privati.

La zona grigia è esattamente qui: tra chi raccoglie (le app, le piattaforme), chi vende (i broker di primo livello), chi aggrega (i broker di secondo livello), e chi compra il profilo finale (lo Stato, le banche, le assicurazioni). Nessun singolo passaggio è tecnicamente illegale. Il risultato finale è una sorveglianza capillare e preventiva su chiunque, senza che nessuno abbia fatto nulla che potesse anche lontanamente giustificarla.

Sofia, Marcus, Elena non erano indagati.

Erano semplicemente nel database.

Come tutti.

Il rischio che l’intelligenza artificiale diventi il braccio armato di una sorveglianza di massa senza precedenti è uno dei due motivi che ha spinto Dario Amodei (Anthropic) a rompere con il Pentagono. L’intelligenza artificiale non deve diventare un’infrastruttura per la sorveglianza automatizzata e universale.

Il rischio è il passaggio definitivo dall’indagine sul singolo alla neutralizzazione preventiva della massa: un mondo in cui non sei più un cittadino protetto da diritti, ma una query in attesa di essere filtrata da un algoritmo.