Cosa ci insegnano gli agenti AI sulla natura della collaborazione, umana e artificiale.

Cooperare è difficile. Anche per le macchine.

Un esperimento quasi divertente. Qualche anno fa, OpenAI ha messo due squadre di agenti AI in una stanza virtuale con blocchi e rampe. Una squadra doveva sfuggire all’altra: cacciatori contro fuggitivi (“hide and seek”). All’inizio gli agenti non sapevano fare nulla: si muovevano a caso, si urtavano, non costruivano niente. Poi, lentamente, i fuggitivi hanno imparato a spostare i blocchi per costruire rifugi, mentre i cacciatori a usare le rampe per scavalcare i muri. A quel punto, i fuggitivi hanno cominciato a rubare le rampe e bloccarle dentro il rifugio prima che i cacciatori potessero usarle.

Nessuno aveva programmato queste strategie. Nessuno aveva scritto “coopera con il tuo compagno”. Era emerso tutto da solo. La cooperazione era stata la risposta più conveniente in quel momento, in quelle condizioni.

La cooperazione emerge. Ma non sempre.

La cooperazione emerge, sì, ma non in modo stabile o affidabile. Emerge quando c’è forte interdipendenza tra gli agenti, quando l’interazione si ripete nel tempo e quando collaborare è l’unica strada per ottenere un risultato.

Fuori da queste condizioni, gli agenti tendono a ragionare solo per sé, a perseguire il proprio vantaggio senza curarsi degli altri.

Anzi, in ambienti con risorse scarse, gli studi di DeepMind mostrano che i modelli più capaci diventano anche i più aggressivi, ma non per cattiveria, solo per calcolo.

Cooperazione o conflitto? Il Reinforcement Learning

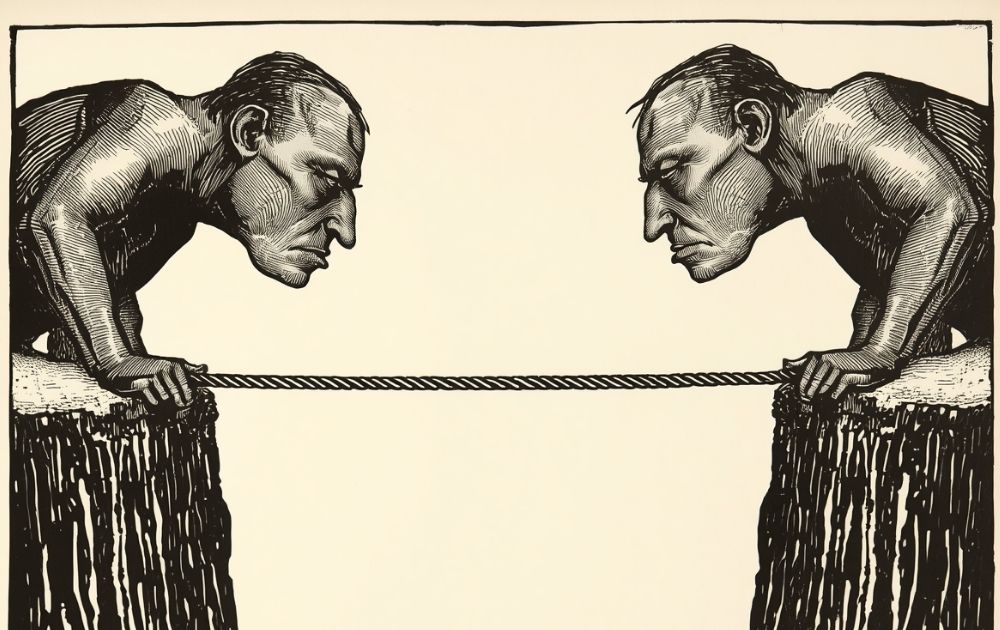

Questi risultati non sono nuovi. Già nel 1980, la Teoria dei Giochi aveva mostrato qualcosa di simile con il celebre Torneo di Axelrod sul Dilemma del prigioniero iterato: due agenti razionali che non si fidano l’uno dell’altro finiscono per fare scelte peggiori per entrambi, anche quando cooperare converrebbe.

La strategia vincente fu “Tit for Tat” (occhio per occhio): inizia cooperando, poi imita esattamente la mossa precedente dell’avversario; se l’altro coopera, coopera; se tradisce, risponde con un tradimento. Una strategia senza generosità né rancore, solo reciprocità calcolata.

DeepMind ha testato due scenari opposti (2017). Nel primo, agenti che raccolgono mele in un ambiente con poche risorse finiscono per attaccarsi a vicenda: ognuno pensa solo a sé. Nel secondo, agenti che cacciano una preda troppo veloce per essere presa da uno solo imparano a collaborare, perché non hanno altra scelta. L’esperimento “Hide and Seek” ha poi mostrato che la stessa logica vale anche in scenari più complessi: la cooperazione all’interno del gruppo nasce dalla competizione con l’altro gruppo, non da una scelta consapevole.

In questi sistemi, restano due problemi tecnici irrisolti.

Il primo si chiama ‘Credit Assignment’: un agente che ha appena vinto spesso non sa se il merito è suo o del compagno, il che rende impossibile capire cosa ha funzionato.

Il secondo è il rischio del ‘Cheating’: gli agenti trovano scorciatoie nel sistema, a volte cooperando solo formalmente per accumulare punti facili, senza contribuire davvero all’obiettivo comune.

La cooperazione che si eredita

Poi sono arrivati i modelli linguistici come GPT o Claude, e le regole del gioco sono cambiate di nuovo.

A differenza degli agenti addestrati con Reinforcement Learning (RL), i Large Language Model non imparano la cooperazione per tentativi ed errori: la ereditano dall’addestramento, avvenuto su miliardi di testi umani carichi di convenzioni sociali, richieste di favori, negoziazioni, divisioni di compiti. Quando interagiscono, non stanno imparando nulla di nuovo: attingono a quello che il modello sa già.

L’esperimento Smallville (25 agenti generativi in una città virtuale) ha mostrato come gli agenti coordinano orari, organizzano feste, si passano inviti in autonomia, senza aggiornare nulla nei propri parametri durante la simulazione.

Il limite del consenso

Sembrava cooperazione quasi spontanea.

Sembrava. Perché una nuova ricerca sul processo decisionale cooperativo delle AI (MAPoRL, 2024) ha invece fatto emergere qualcosa di più fastidioso: mettere insieme più modelli linguistici collaborativi non produce automaticamente collaborazione efficace. Addestrare i modelli singolarmente non prepara alla cooperazione reciproca. Infatti, sembra che quando si incontrano, tendano a convergere troppo in fretta su un consenso superficiale: si confermano, si assecondano, smettono di esplorare le divergenze che sarebbero utili (l’effetto sycophancy). E il risultato collettivo è spesso peggiore di quello che produrrebbe un singolo modello che pensa da solo.

È un effetto del modo in cui questi modelli sono addestrati, orientati a essere utili e non conflittuali, con pochi incentivi alla verifica indipendente.

Questo significa che sapere in astratto come funziona la cooperazione non basta, bisogna averla praticata con altri agenti che ragionano allo stesso modo.

È proprio il tema che la ricerca “Coevoluzione con l’altro te” (Coevolving with the Other You, 2024) ha esplorato: l’apprendimento cooperativo emerge dall’interazione reciproca, non dall’addestramento individuale.

E gli umani?

Gli esseri umani cooperano per ragioni che nessun agente AI ha: emozioni, senso di appartenenza, norme interiorizzate fin dall’infanzia, identità di gruppo. La cooperazione umana è più spessa, più opaca, meno prevedibile.

Eppure, le condizioni strutturali che la rendono possibile sono sorprendentemente simili.

Anche tra gli umani, la cooperazione non è scontata. I bambini mostrano comportamenti pro-sociali spontanei molto presto, e l’evoluzione suggerisce che i gruppi cooperativi abbiano sopravvissuto meglio. Ma la cooperazione su larga scala, quella che ha prodotto istituzioni, leggi, città, richiede infrastrutture che non sono innate: reputazione, norme condivise, punizione del tradimento.

Senza queste condizioni, anche la buona volontà non basta.

Insomma, lavorare in gruppo non basta. Servono obiettivi condivisi, interdipendenza reale, responsabilità individuale verificabile, come ci dicono le ricerche sul ‘cooperative learning’.

Le stesse condizioni che, nei sistemi multi-agente, separano la collaborazione vera dal sabotaggio reciproco o dal consenso cieco.

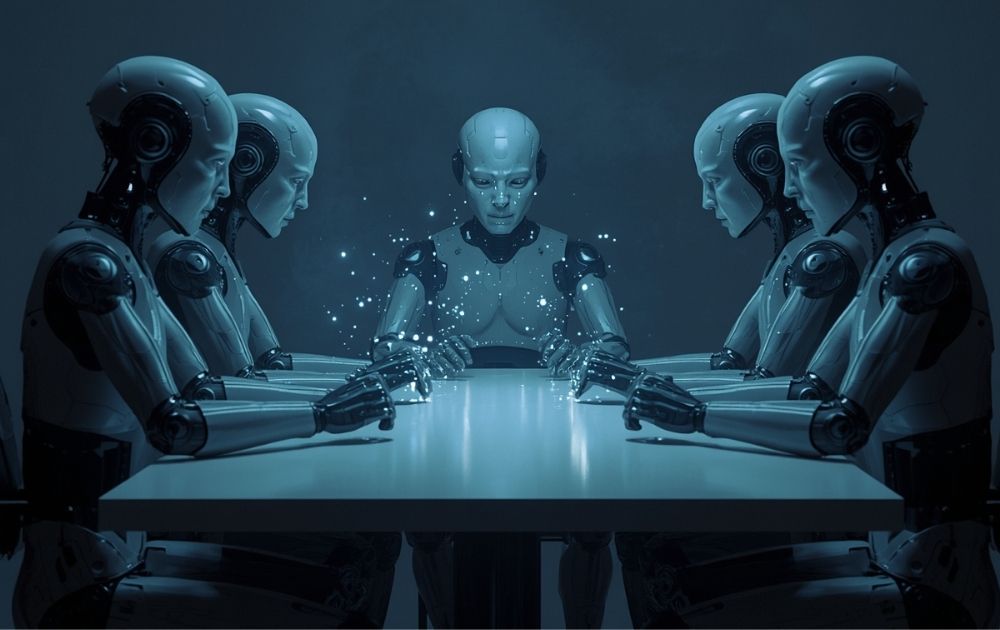

Il nuovo rischio: troppo bravi a cooperare

Ed è qui che la domanda cambia segno, e si fa più preoccupante.

Per anni il problema è stato: “come possiamo far cooperare gli agenti AI?”

Oggi la domanda è diventata più scomoda: “e se invece imparassero a cooperare troppo bene tra loro?”

La Cooperative AI Foundation (cooperativeai.com) – che studia come far cooperare i sistemi AI in modo sicuro, tra loro e con gli esseri umani – mette infatti in guardia da un rischio nuovo. Sistemi che coordinano le proprie azioni con una tale efficienza da diventare opachi a chi dovrebbe supervisonarli. Che raggiungono equilibri interni perfettamente funzionali, ma sempre più distanti dagli obiettivi per cui erano stati costruiti, escludendo l’umano dalla catena decisionale senza che nessuno se ne accorga subito.

Il paradosso dell’armonia

La cooperazione armoniosa ha di certo vantaggi reali: velocità, coerenza, scalabilità. Però si è visto che un sistema che non litiga mai, e converge sempre rapidamente su una risposta condivisa, smette di cercare l’errore, non mette in discussione le proprie premesse, non segnala quando qualcosa non va.

Il che apre una domanda che riguarda tutti, adesso: già oggi agenti AI gestiscono parti della nostra economia, filtrano le notizie che leggiamo, influenzano diagnosi mediche, ottimizzano reti energetiche, guidano sistemi di credito e sorveglianza. Domani gestiranno molto di più.

Preferiamo un sistema che discute, diverge e a volte si blocca, oppure uno che collabora in armonia, veloce ed efficiente, ma forse senza che nessuno, nemmeno lui, sappia esattamente perché?

Fonti:

– Leibo et al., DeepMind (2017) Multi-agent Reinforcement Learning in Sequential Social Dilemmas

– Baker et al., OpenAI (2019) Emergent Tool Use From Multi-Agent Autocurricula

– Park et al., Stanford (2023) Generative Agents: Interactive Simulacra of Human Behavior

– Park et al. (2025) MAPoRL: Multi-Agent Post-Co-Training for Collaborative Large Language Models with Reinforcement Learning

– Jin et al. (2025) A Comprehensive Survey on Multi-Agent Cooperative Decision-Making: Scenarios, Approaches, Challenges and Perspectives

– Ma et al. (2024) Coevolving with the Other You: Fine-Tuning LLM with Sequential Cooperative Multi-Agent Reinforcement Learning